Internet

Joven crea inteligencia artificial que traduce el lenguaje de señas

Es estudiante de ingeniería de tercer año del Instituto de Tecnología de Vellore en India.

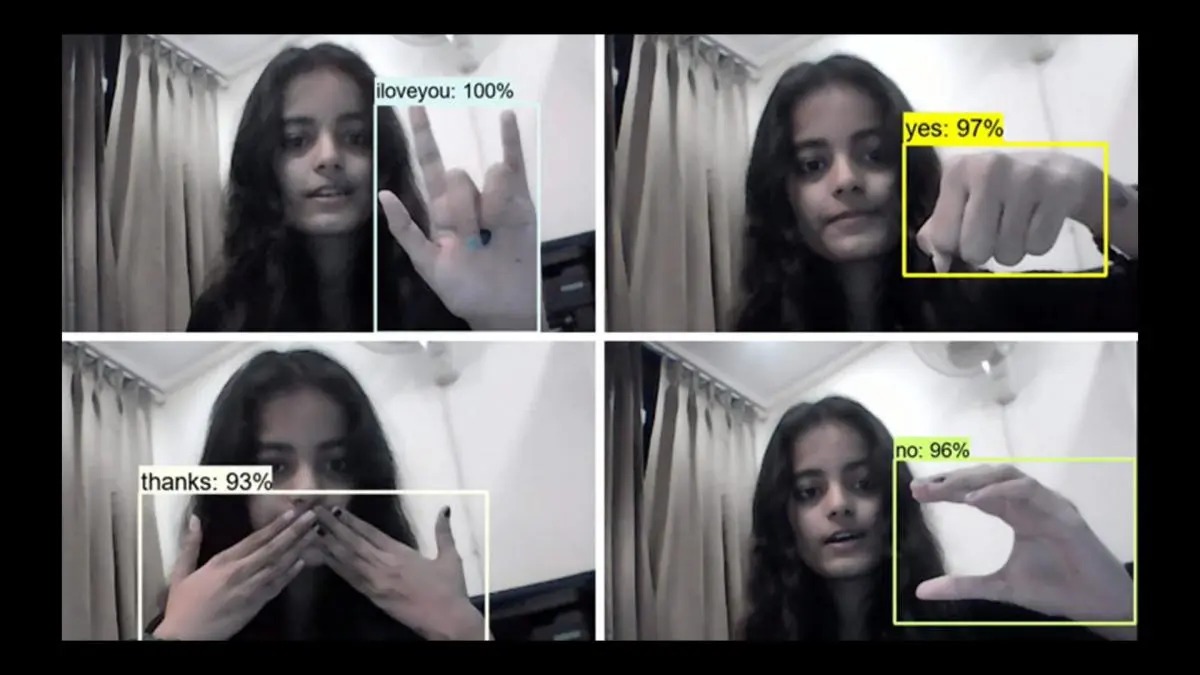

Priyanjali Gupta, estudiante de ingeniería de tercer año del Instituto de Tecnología de Vellore en India, ha desarrollado un impresionante modelo de inteligencia artificial capaz de traducir el lenguaje de señas estadounidense al inglés en tiempo real.

Según Priyanjali, su modelo impulsado por IA recientemente desarrollado está inspirado en el video del científico de datos Nicholas Renaut sobre la detección del lenguaje de señas en tiempo real.

"Inventé un modelo de IA usando la API de detección de objetos de Tensorflow que traduce los gestos de las manos usando el aprendizaje de transferencia de un modelo previamente entrenado llamado ssd_mobilenet", comparte.

Agregó que “el conjunto de datos se genera manualmente usando una cámara web de computadora y anotaciones. El modelo, por ahora, está entrenado en fotogramas individuales. Para detectar videos, el modelo debe entrenarse en múltiples fotogramas, en los que probablemente usaré memoria a largo plazo (LSTM ) redes", refiiró Priyanjali.

También mencionó que construir un modelo de aprendizaje profundo dedicado a la detección del lenguaje de señas es un gran desafío y cree que la comunidad de código abierto encontrará una solución pronto. Indicó además que puede ser posible construir modelos de aprendizaje profundo solo para lenguajes de señas en el futuro.

A principios de 2016, dos estudiantes de la Universidad de Washington llamados Thomas Pryor y Naveed Azudi inventaron un par de guantes llamados SignAloud, que pueden traducir el lenguaje de señas en voz o texto.

Ganaron el concurso Lemelson-MIT por su participación en SignAloud.